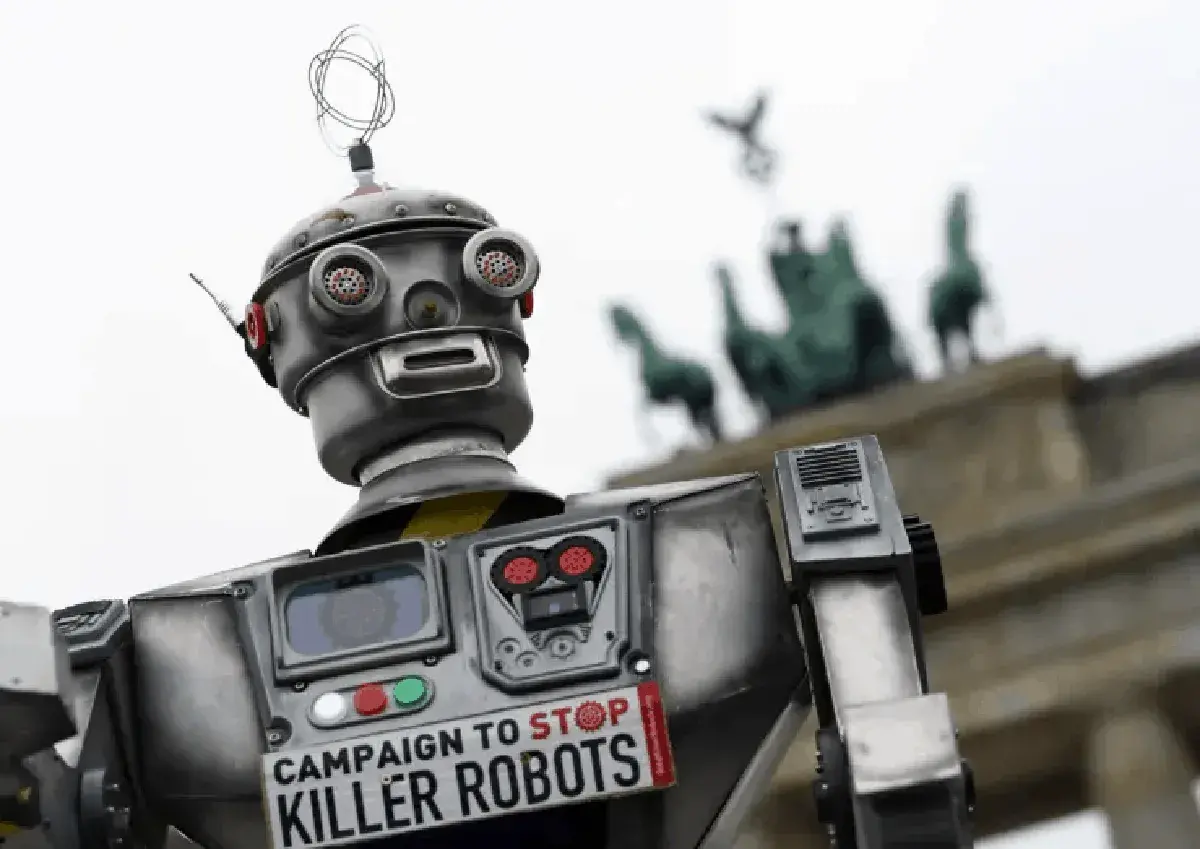

¿Es hora de que la sociedad inicie un debate serio sobre las armas autónomas?. Con la reunión prevista entre los presidentes Donald Trump y Xi Jinping el jueves, y Taiwán como tema central de la conversación, resulta evidente que tanto Estados Unidos como China están invirtiendo importantes recursos en el desarrollo de drones, misiles y otros sistemas balísticos capaces de localizar, seguir y destruir objetivos, e incluso de matar personas.

He estado reflexionando sobre esto desde que conversé con John Dulin, cofundador de la empresa emergente de tecnología de defensa Modern Intelligence, quien me convenció de que este debate está estancado en el pasado.

Le señalé a Dulin que mi robot aspirador de fabricación china incorpora tecnología suficiente para ser utilizado en un arma autónoma (aunque no muy sofisticada). Los ejércitos han ido mucho más allá. La pregunta que queda es dónde trazamos los límites y en qué momento otorgamos al software el poder de matar.

La respuesta automática de la mayoría a esa pregunta es «nunca», y la opinión generalizada es que los sistemas letales requieren la intervención humana: un oficial de la Fuerza Aérea o un civil, en un edificio en Virginia o Kiev, pulsando el botón letal.

El problema es que las armas autónomas representan un continuo. Por ejemplo: los drones pueden ser pilotados remotamente por un humano y luego pasar a modo autónomo una vez identificado el objetivo para evitar interferencias tecnológicas.

Pasar del nivel actual de autonomía a escenarios donde la IA localiza el objetivo por sí sola es principalmente un desafío de software, que se está abordando para uso civil en el sector privado.

Los escenarios hipotéticos son complejos: ¿Qué ocurre con ataques demasiado rápidos para ser detectados por humanos?. ¿Qué sucede si un adversario interrumpe la comunicación entre el humano y el arma?. Merece la pena debatir públicamente cuestiones difíciles como el estándar de precisión. Desplegar un arma con un 99,9999% de probabilidad de alcanzar el objetivo previsto es muy diferente a un 90%. ¿Dónde se traza la línea?.

ÁMBITO PARA LA DISCREPANCIA.

En un artículo de opinión para la publicación de TI CIO, el experto en ciberseguridad Lee Barney escribió que existen amenazas más urgentes que abordar que los “robots asesinos”. La disminución de la interacción humana, la sustitución de empleos y el cambio en las prioridades educativas están transformando la sociedad y obligando a padres, empresas y gobiernos a modificar sus prácticas.

NOTABLE.

Para proteger a la población civil, el Pentágono debería desarrollar herramientas de IA que se ajusten a su modus operandi, que difiere del funcionamiento del mundo civil, según declaró a Politico el subsecretario adjunto de Defensa para política cibernética durante la administración Biden.