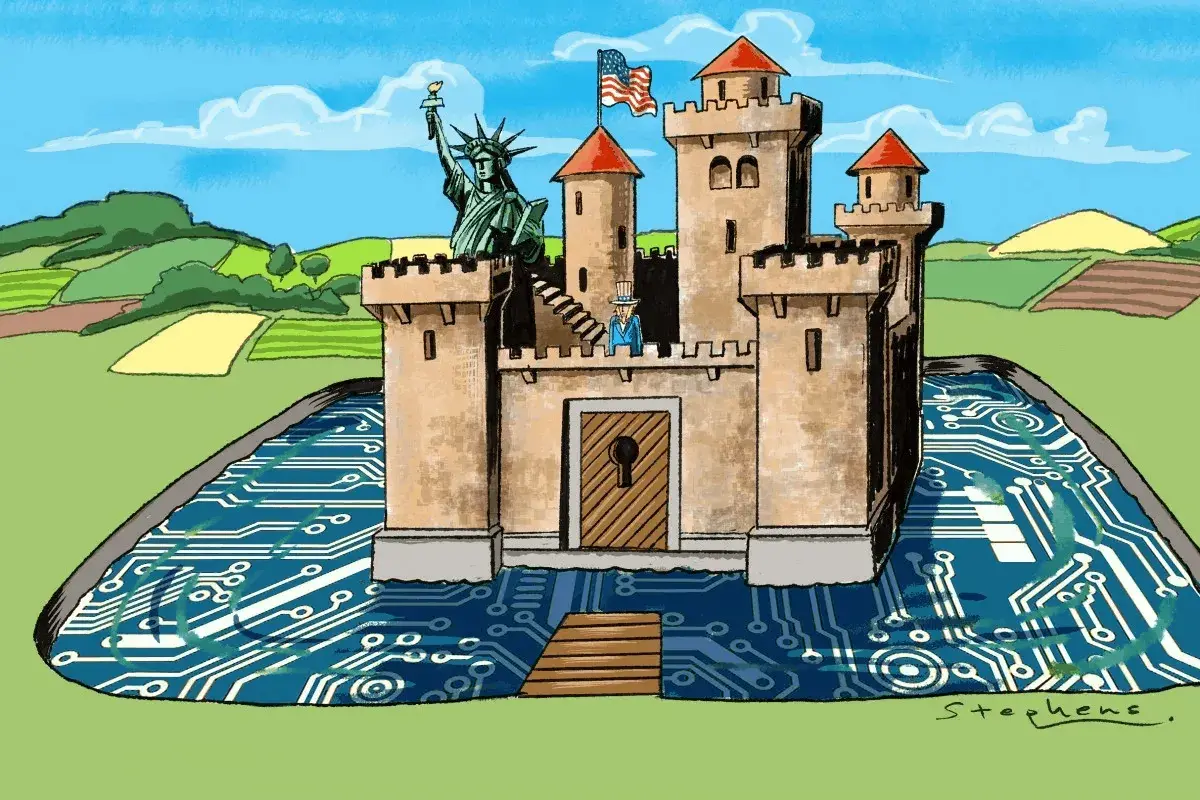

Elevar las barreras de entrada al sector tecnológico en nombre de la seguridad nacional podría frenar el desarrollo global de la IA.

El Comité Selecto de la Cámara de Representantes de Estados Unidos sobre China publicó recientemente un informe sobre inteligencia artificial. Titulado «Comprar lo que pueda, robar lo que deba: la campaña de China para adquirir capacidades de IA de vanguardia», refleja una visión cada vez más intransigente en Washington que considera que el auge de la inteligencia artificial en Beijing está estrechamente vinculado tanto al acceso al mercado como a las preocupaciones de seguridad.

Independientemente de si está plenamente fundamentada o no, esta creencia está influyendo cada vez más en la perspectiva política con la que se entiende la competencia tecnológica entre ambos países en EE.UU.: menos como una cuestión de innovación y más como una cuestión de seguridad nacional. En este contexto, la reciente controversia sobre la destilación de modelos, en la que participan importantes empresas estadounidenses como OpenAI, Anthropic y Alphabet, ha acaparado gran atención. La coordinación entre estas compañías, que se produce poco después del impulso de Washington para crear un sistema integral de exportación de IA, sugiere que lo que parece ser una disputa técnica forma parte, en realidad, de un cambio más amplio en la forma en que se rige —y se cuestiona— la IA a nivel global.

A primera vista, el debate sobre la destilación de modelos se centra en aspectos técnicos y límites de la propiedad intelectual. La destilación es una técnica de aprendizaje automático ampliamente utilizada que permite que modelos más pequeños alcancen un rendimiento similar al de modelos más grandes, reduciendo los costes computacionales y acelerando su adopción. Su estatus legal sigue siendo ambiguo, e incluso empresas estadounidenses han utilizado métodos similares entre sí.

Sin embargo, en el actual entorno geopolítico, la cuestión se ha replanteado. Algunos responsables políticos y empresas estadounidenses argumentan que los modelos destilados podrían utilizarse indebidamente para operaciones cibernéticas, campañas de desinformación o incluso aplicaciones militares. Lo que antes era una cuestión de optimización se ha elevado a la categoría de seguridad nacional.

Este cambio refleja una transformación más profunda en la gobernanza de la IA en Estados Unidos. En los últimos años, Washington ha pasado de centrarse principalmente en la seguridad de la IA —incluidos los riesgos éticos y los daños algorítmicos— a un paradigma más orientado a la seguridad, centrado en la competencia estratégica y el control tecnológico. Si bien el discurso sobre la seguridad no ha desaparecido, se fusiona cada vez más con consideraciones de seguridad nacional.

Xiao Qian.

Xiao Qian es subdirector del Centro de Seguridad y Estrategia Internacional y vicedecano del Instituto de Gobernanza Internacional de la IA en la Universidad de Tsinghua.